マネジメント

マネジメント データ活用の課題解決!モダンデータスタック(MDS)でROIを最大化

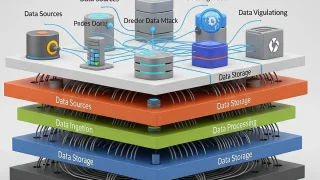

モダンデータスタック(Modern Data Stack, MDS)をご存じでしょうか? まだ、日本では馴染みのないMDSですが、今、海外の最先端なデータエンジニアリングの現場では、企業のデータ分析の現場で挙がってくる「迅速なインサイト抽出の難しさ」と「データ資産運用化の複雑性」といった課題に対し、データの分析、効率性向上、新たな機会発見をより迅速かつ低コストで実現することができるモダンデータスタック(MDS)に注目が集まっています。今回は、"モダンデータスタック(Modern Data Stack, MDS)の基本的な解説"の他、"MDSがもたらすROI最大化の効果"について、ご紹介していきます。